中文|爱数智慧CEO张晴晴:基于”情感“的人机交互,要从底层数据开始( 二 )

一是个体语言体系的差异化,由于所处地域、文化、教育背景的不同,每个人的语言表达都是独特的,这种个性化在人与人之间的沟通中都难免出现理解偏差,更何况是一台机器。对于AI而言,中文不是一种语言,而是13亿种语言。

二是对话式口语常常会有语序颠倒,犹豫、迟疑产生的停顿,在复杂的多人交互场景中,也不可避免会出现语句打断、抢话、交叠音等问题,这些语音特征为 AI 建模带来了很大困难。

在张晴晴看来,真实的对话数据和多语种语料库建设是解决上述问题的关键。“当前行业提供的大部分人工智能数据都以朗读式训练数据为主,而人与人自然的对话式数据对训练对话式 AI 有更加关键的作用;我们需要为机器注入知识图谱、中文、方言、外语等多种语料,才能让机器像人一样理解自然语言”。

据悉,爱数智慧已拥有超过20万小时数据产品,涵盖超过60种语言,既有英语、日语等常用语种,也提供马来语、泰语、印尼语等特色语种。张晴晴于2016年创办人工智能数据公司爱数智慧,面向智慧金融,智能出行、智能家居、智能社交、智慧终端等领域提供数据服务,包括数据的定向采集、数据的处理、标签化,以及高效的数据处理工具等。在她看来,“人工智能三驾马车中,数据是算法的食粮,数据好比原油,只有经过清洗、分类、标注、质检和筛选等结构化过程,才能用于AI模型训练。”

在本次主题报告中,张晴晴将从对话式AI出发,探讨对话式口语交互为语音识别带来哪些挑战,如何通过双语声学建模、发音词典如何构建双语识别系统,解决非母语发音的插入语问题,以及介绍多语种语料库建设对AI识别率提升起到积极的作用。

值得关注的是,为了满足日益多样化的场景需要,多模态取代单一人机交互成了产学界普遍关注的新方向。所谓多模态是指融合视觉、听觉、触觉、嗅觉甚至味觉的交互方式,其表达效率和信息都优于单一的视觉或听觉模式。张晴晴表示,在自然语言、视觉和语音技术日渐成熟的今天,多模态的兴起是人工智能向前发展的必然趋势。

“人类对世界的认知也并不是单模态的。在AI真正落入产业的过程中,我们发现语音、图像、文本之间的相互融合是一个不能避免的问题。”在人机交互过程中,机器要想感知人的情感色彩,光靠声音是不够的。人的情绪既可能体现在声音中,也可能蕴含在面部表情或语言内容中,情绪感知是一个多模态综合评价的结果。

在本次论坛中,美的集团IoT副总裁兼CTO向江旭、阿里巴巴达摩院研究员田彪都将带来有关多模态人机交互的主旨演讲。

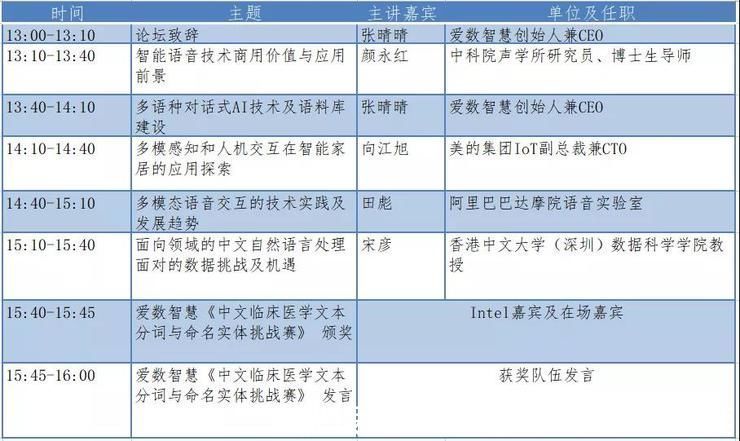

论坛主旨报告安排CNCC2021【人机交互技术的机遇与挑战】技术论坛将于2021年10月28日13:00-16:00在深圳国际会展中心CC105B召开,爱数智慧创始人兼CEO张晴晴担任论坛主席,中科院声学所研究员、博士生导师颜永红担任共同主席。本次论坛分为主旨报告和颁奖仪式两个主要环节。以下为参会嘉宾的报告内容:

文章插图

文章插图

分享嘉宾:颜永红,中科院声学研究员、博士生导师

题目:智能语音技术商用价值与应用前景

【 中文|爱数智慧CEO张晴晴:基于”情感“的人机交互,要从底层数据开始】随着智能语音在各场景的应用落地,智能语音交互核心技术在关键行业领域的商业应用前景和价值也越来越大,将成为引领新一轮产业集群开发与传统企业升级的核心认知。报告将深度评估与解析全球及我国在智能语音领域关键性技术并给出前瞻的应用创新建议。

- 荣耀|今年过节不乱跑,荣耀智慧屏1499起,和年夜饭一样真香

- 社区矫正中心|邯山区司法局推进“智慧社区矫正中心”建设,打造实战平台,提升矫正

- 日前|“黑科技”来了!旬阳法院打造“智慧诉讼服务”新模式

- “上海图书馆东馆的定位是新一代的智慧复合型图书馆。|美好生活需要怎样的美好阅读?上图东馆定位新一代智慧复合型图书馆

- 智能店|京东云、居然智慧家推“京鱼座”全屋智能店,将覆盖300城

- 地球上的我们正在经历一个前所未有的历史演变也许|预告|智慧地球之元宇宙重磅来袭,1月15日下午14时全网直播

- 华为全场景感恩回馈季来临,多款华为智慧屏值得入手

- 叶永忠:积极构筑智慧联接新底座 打造中型智慧城市标杆

- 36氪5G创新日报0114|中国首套三端5G配网差动保护装置在青海投入运行;国内核电首个5G智慧仓储项目“慧仓一号”正式投用 | 广州联通

- 互联网+|“互联网+”让就医更便捷 诊疗更智慧